Епоха штучного інтелекту: між жорстокою красою коду та цифровим расизмом

Ми стоїмо на порозі нової ери – ери штучного інтелекту. Ця епоха водночас зачаровує своєю потенційною могутністю і лякає непередбачуваністю наслідків. Останніми місяцями новини переповнені розробками, пов’язаними зі штучним інтелектом, від захоплюючих досягнень у створенні відео до проблем із розпізнаванням облич і навіть появи цифрових домашніх тварин, які можуть вести вас містом. Все це, як мозаїка, складається в картину майбутнього, якого ми, можливо, вже не впізнаємо.

Жорстока краса мови асемблера та глибина розуміння

Перше, що спадає на думку, коли мова йде про штучний інтелект, це складні алгоритми, нейронні мережі та машинне навчання. Однак під усією цією високорівневою абстракцією лежить основа – мова асемблера. Програмування збірки, без сумніву, жорстокий процес. Це вимагає глибокого розуміння архітектури комп’ютера, маніпуляції з бітами та байтами, а також готовності нескінченно налагоджувати. Але в цій жорстокості криється особлива краса.

Коли ви пишете асемблерний код, ви буквально розмовляєте з машиною, кажучи їй, що робити крок за кроком. Ви бачите, як працює комп’ютер зсередини, розумієте його обмеження та можливості. І це розуміння дозволяє створювати дійсно ефективні та оптимізовані рішення.Пам’ятаю, як в студентські роки я писав драйвер для звукової карти на асемблері. Це було важко, виснажливо, але неймовірно хвилююче. Відчуття, коли ви бачите, як ваш код оживає і змушує апаратне забезпечення працювати саме так, як ви планували, незрівнянне ні з чим.

Саме це глибоке розуміння, отримане під час роботи з низькорівневим кодом, може бути ключем до створення справді інтелектуального ШІ. Недостатньо просто навчити нейронну мережу на величезній кількості даних. Необхідно зрозуміти, як ця мережа працює на найнижчому рівні, щоб її можна було вдосконалювати та оптимізувати.

Пастка еншіттифікації: коли ШІ стає жертвою власних помилок

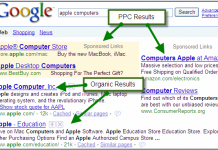

Теорія Корі Доктороу про енчітифікацію, згідно з якою технологічні платформи гниють зсередини, здається, набуває все більшої актуальності в контексті розвитку ШІ. Чим прибутковішим і потужнішим стає штучний інтелект, тим більша ймовірність того, що він зіткнеться з тими ж проблемами, що й соціальні мережі: гонка за залученням, упередженість алгоритмів, поширення дезінформації.

Я вважаю, що одна з головних небезпек полягає в тому, що ми занадто сильно покладаємося на ШІ для вирішення складних проблем, не враховуючи, що самі алгоритми можуть бути упередженими та неправильними. Наприклад, алгоритми, які використовуються для надання позик або прийняття рішень про наймання, можуть дискримінувати певні групи людей, якщо вони навчаються на необ’єктивних даних.

Щоб уникнути пастки енчітифікації, необхідно створити ШІ, який буде прозорим, пояснюваним і керованим. Необхідно розробити алгоритми, які враховують етичні принципи та людські цінності. І найголовніше, ми повинні пам’ятати, що ШІ – це лише інструмент, і відповідальність за його використання лежить на нас.

Цифровий расизм: коли ШІ не бачить облич

Проблема розпізнавання облич є ще одним важливим аспектом розвитку ШІ. Приблизно 100 мільйонів людей живуть з відмінностями в обличчі. І коли технологія розпізнавання обличчя стає широко поширеною, деяким людям фактично блокується доступ до важливих систем і служб.

Це не просто технічна проблема. Це питання соціальної справедливості. Необхідно розробити алгоритми, які будуть працювати для всіх, незалежно від їх зовнішнього вигляду. Необхідно створювати системи, які враховуватимуть різноманіття людських облич і не дискримінуватимуть людей з особливими потребами.

ByteDance зі своїми додатками Doubao та Cici демонструє, що зручний дизайн і агресивний маркетинг можуть швидко призвести до популярності, навіть якщо технічні характеристики не найсучасніші. Але це не усуває необхідності вирішення етичних питань, пов’язаних із використанням ШІ.

Розваги та майбутнє: Sora, доповнена реальність і STEM

Такі програми, як Sora від OpenAI, дозволяють створювати цифрові аватари та генерувати відео з ними. Це відкриває нові можливості для розваг і творчості. Але водночас це викликає питання щодо автентичності та маніпуляції.Я вважаю, що важливо пам’ятати, що створені штучним інтелектом відео не завжди відображають реальність.

Niantic зі своїм проектом Peridot демонструє, як доповнену реальність можна використовувати для створення інтерактивних та освітніх програм. Розмовляючий собака-інопланетянин, який водить вас містом і розповідає цікаві факти, — чудовий спосіб залучити дітей до навчання.

І, звичайно, важливо не забувати про STEM-освіту. Роздуми про науку й технології з точки зору повернення інвестицій упускають суть.STEM – це не лише майбутня робота. Йдеться про розвиток критичного мислення, навичок вирішення проблем та адаптації до мінливого світу. Важливо виховувати у дітей любов до знань і цікавість до навколишнього світу.

Висновок: баланс між прогресом і відповідальністю

Ера штучного інтелекту – це час великих можливостей і великих ризиків. Ми стоїмо на порозі революції, яка може змінити світ на краще. Але щоб це сталося, необхідно пам’ятати про відповідальність. Необхідно створити ШІ, який буде прозорим, зрозумілим і керованим. Необхідно розробити алгоритми, які враховують етичні принципи та людські цінності. Необхідно виховувати у дітей любов до знань і цікавість до навколишнього світу.

Зрештою, майбутнє штучного інтелекту залежить від нас. Ми повинні бути готові до викликів, які вона ставить, і використовувати її можливості, щоб створити кращий світ для всіх. Необхідно знайти баланс між прогресом і відповідальністю, щоб не стати жертвою власних творінь.